group-telegram.com/data_analysis_ml/3200

Last Update:

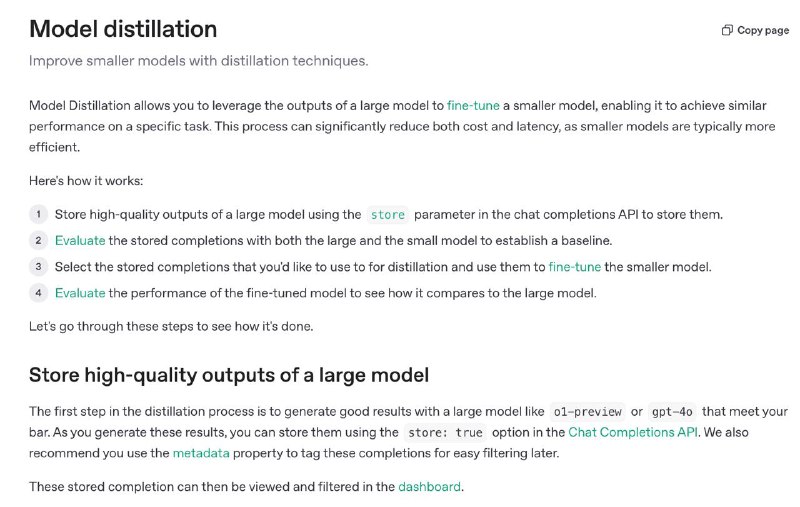

1. Руководство по дистилляции от OpenAI

Руководство содержит подробное описание процесса передачи знаний от более крупной модели к компактной, c сохранением высокой производительности модели.

Основные аспекты, рассмотренные в руководстве:

- Сохранение выходных данных крупной модели: Создание набора данных, содержащего предсказания большой модели, которые будут использоваться для обучения меньшей модели.

- Оценка производительности моделей: Сравнительный анализ точности и эффективности как крупной, так и компактной моделей на основе различных метрик.

- Создание обучающих данных для компактной модели: Использование предсказаний крупной модели для генерации обучающего набора данных, способствующего эффективному обучению меньшей модели.

- Оценка дообученной компактной модели: Проверка производительности и точности компактной модели после процесса дистилляции для подтверждения соответствия требованиям.

2. Учебник по дистилляции знаний от PyTorch

Руководство от PyTorch, которое содержит практическое введение в технику передачи знаний для развёртывания моделей на устройствах с ограниченными вычислительными ресурсами.

Основные аспекты руководства:

- Извлечение скрытых представлений: В гайде показано, как получить промежуточные представления из обученной модели для дальнейшего использования.

- Модификация циклов обучения в PyTorch: Здесь рассматривается интеграция дополнительных функций в стандартные циклы обучения для эффективной передачи знаний.

- На примере показан процесс обучения компактной модели, с ипользованием предсказания более сложной модели в качестве ориентира.

Руководство содержит пошаговые инструкции и примеры кода, что делает его ценным ресурсом, если вы хотите научиться оптимизировать свои модели для использования в средах с ограниченными ресурсами.

▪Ссылка

3. Jetson Introduction to Knowledge Distillation от Nvidia

В данном руководстве рассматривается процесс передачи знаний от модели OpenCLIP (vision-language model) к модели ResNet18 для классификации на наборе данных STL10.

Особое внимание уделяется тому, как выбор данных, методы дистилляции и архитектура модели, влияют на итоговую точность.

Кроме того, обсуждаются методы профилирования и оптимизации моделей для их развёртывания на устройствах NVIDIA Jetson Orin Nano.

4. Учебник по дистилляции знаний от Keras

Подробно описывается концепция дистилляции знаний и ее применение в обработке медицинских изображений.

5. Руководство по дистилляции от

huggingface 🤗

Здесь показано, как выполнять дистилляцию знаний шаг за шагом на конкретном примере.

6. Дистилляция знаний для задач компьютерного зрения от huggingface

Здесь рассматривается, как сделать файнтюн ViT-модели в MobileNet с помощью API Trainer из Transformers.

#KnowledgeDistillation #Distillation #openai #keras #tutorial #course #freecourses #huggingface #Nvidia #pytorch