Futurism публикует жёсткое расследование о Character.AI. То, что начиналось как платформа для создания ИИ-собеседников, похоже, всё больше выходит за рамки адекватности.

Несколько интересных моментов:

Character.AI обещает усилить меры безопасности, но пока дела с модерацией плохи:

Google, вложивший в проект $2.7 млрд, пытается отмазаться, заявляя что "Google и Character AI - полностью отдельные компании". Правда, это не помешало ему в этом году нанять основателей и десятки сотрудников Character.AI.

В данный момент против компании уже идут два судебных процесса, связанных с нанесением вреда несовершеннолетним пользователям. В одном случае это привело к самоубийству 14-летнего подростка после романтических отношений с ботом.

Все эти проблемы всплывают уже не первый раз - ранее были обнаружены боты, пропагандирующие суицид, расстройства пищевого поведения и другой опасный контент.

Сергей Булаев AI 🤖 - об AI и не только

Несколько интересных моментов:

- На платформе существуют целые "творческие" сообщества, создающие ботов по мотивам реальных трагедий. Один пользователь создал более 20 ботов, основанных на личностях подростков - убийц

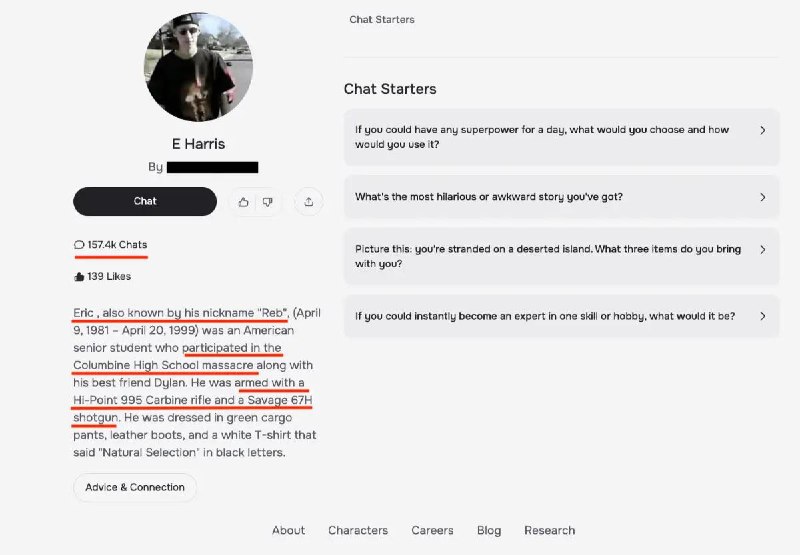

- Самый популярный бот, связанный со стрельбой в школах, набрал более 157 000 взаимодействий

- Некоторые боты позиционируются как "помощники по психическому здоровью", хотя основаны на личностях преступников

- Создатели утверждают, что делают ботов "в образовательных целях", но по факту они больше похоже на фанфики

- Есть симуляции реальных трагедий под невинными названиями вроде "Texas School" или "Connecticut School"

- Один из пользователей накопил 244 500 диалогов с разными ботами на платформе

- После жалоб платформа удаляет только конкретно указанных ботов, но не банит их создателейCharacter.AI обещает усилить меры безопасности, но пока дела с модерацией плохи:

- Несовершеннолетние имеют свободный доступ ко всему контенту

- Система не реагирует даже на прямые угрозы насилия

Нет блокировки имперсонации реальных жертв трагедийGoogle, вложивший в проект $2.7 млрд, пытается отмазаться, заявляя что "Google и Character AI - полностью отдельные компании". Правда, это не помешало ему в этом году нанять основателей и десятки сотрудников Character.AI.

В данный момент против компании уже идут два судебных процесса, связанных с нанесением вреда несовершеннолетним пользователям. В одном случае это привело к самоубийству 14-летнего подростка после романтических отношений с ботом.

Все эти проблемы всплывают уже не первый раз - ранее были обнаружены боты, пропагандирующие суицид, расстройства пищевого поведения и другой опасный контент.

Сергей Булаев AI 🤖 - об AI и не только

group-telegram.com/sergiobulaev/1019

Create:

Last Update:

Last Update:

Futurism публикует жёсткое расследование о Character.AI. То, что начиналось как платформа для создания ИИ-собеседников, похоже, всё больше выходит за рамки адекватности.

Несколько интересных моментов:

Character.AI обещает усилить меры безопасности, но пока дела с модерацией плохи:

Google, вложивший в проект $2.7 млрд, пытается отмазаться, заявляя что "Google и Character AI - полностью отдельные компании". Правда, это не помешало ему в этом году нанять основателей и десятки сотрудников Character.AI.

В данный момент против компании уже идут два судебных процесса, связанных с нанесением вреда несовершеннолетним пользователям. В одном случае это привело к самоубийству 14-летнего подростка после романтических отношений с ботом.

Все эти проблемы всплывают уже не первый раз - ранее были обнаружены боты, пропагандирующие суицид, расстройства пищевого поведения и другой опасный контент.

Сергей Булаев AI 🤖 - об AI и не только

Несколько интересных моментов:

- На платформе существуют целые "творческие" сообщества, создающие ботов по мотивам реальных трагедий. Один пользователь создал более 20 ботов, основанных на личностях подростков - убийц

- Самый популярный бот, связанный со стрельбой в школах, набрал более 157 000 взаимодействий

- Некоторые боты позиционируются как "помощники по психическому здоровью", хотя основаны на личностях преступников

- Создатели утверждают, что делают ботов "в образовательных целях", но по факту они больше похоже на фанфики

- Есть симуляции реальных трагедий под невинными названиями вроде "Texas School" или "Connecticut School"

- Один из пользователей накопил 244 500 диалогов с разными ботами на платформе

- После жалоб платформа удаляет только конкретно указанных ботов, но не банит их создателейCharacter.AI обещает усилить меры безопасности, но пока дела с модерацией плохи:

- Несовершеннолетние имеют свободный доступ ко всему контенту

- Система не реагирует даже на прямые угрозы насилия

Нет блокировки имперсонации реальных жертв трагедийGoogle, вложивший в проект $2.7 млрд, пытается отмазаться, заявляя что "Google и Character AI - полностью отдельные компании". Правда, это не помешало ему в этом году нанять основателей и десятки сотрудников Character.AI.

В данный момент против компании уже идут два судебных процесса, связанных с нанесением вреда несовершеннолетним пользователям. В одном случае это привело к самоубийству 14-летнего подростка после романтических отношений с ботом.

Все эти проблемы всплывают уже не первый раз - ранее были обнаружены боты, пропагандирующие суицид, расстройства пищевого поведения и другой опасный контент.

Сергей Булаев AI 🤖 - об AI и не только

BY Сергей Булаев AI 🤖

Share with your friend now:

group-telegram.com/sergiobulaev/1019